出品:新浪科技《科学大家》、高山大学

撰文:郭毅可,英国皇家工程院院士、欧洲科学院院士、英国帝国理工大学教授、香港浸会大学副校长

编者按:截止3月3日,新冠疫情已导致80303人感染。疫情肆虐,如何能更好地研究病毒的传播途径?数据科学在这里面又起到了哪些作用?

实际上,流行病学本身是数据科学最重要的分支之一。在流行病疫情防控上,数据科学不止是统计每天的疫情数据,另外它还是理解流行病的传染特性、传染规律和控制策略的有效性的重要手段。

想要了解数据科学的作用,就需要从流行病的定义谈起。传染病是指由特定的传染物(比如病毒、细菌),通过从受感体(人、动物、植物)直接或间接地传播给易感体,使易感体被传染的疾病。

英国霍乱大暴发,多亏了数据科学

19世纪中期,英国本土暴发了霍乱。当时科学家、医生和政府官员对霍乱不了解,一筹莫展,眼睁睁看着疫情蔓延。这时,一些医生观察到,病人的分布常常是穷人区域里的比较多,且散发恶臭的地方比较容易得病,于是便提议用除臭剂来阻止霍乱流行,更有官员提出要把恶臭的地方彻底清掉。

但清洗伦敦后,霍乱开始了第二次暴发,死亡人数比第一次多了3倍之多。问题出在哪里呢?当时人们做了很多观察,但都没有做统计意义上的分析。此时一位医生约翰·斯诺,他走访了死亡患者的家庭,了解有患者家庭和无患者家庭间的区别,对比他们的生活条件、周边环境、生活方式有什么根本不同,收集了很多数据。

利用这些数据,约翰·斯诺最终确定霍乱暴发和水源有关。随后,通过拒绝饮用伦敦苏荷区宽街与苏克莱星街交汇处的一处水井,伦敦霍乱患病率开始降低。

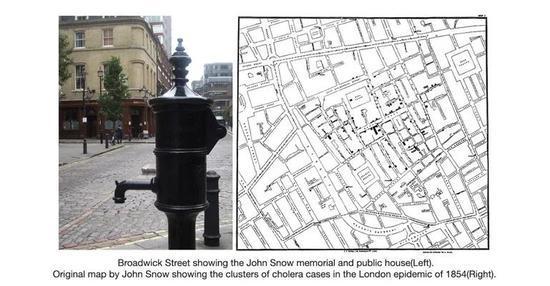

纪念斯诺而保留的水泵和他当年调查绘制的地图,图自网络

30年后,德国的微生物学家罗伯特·科赫发现霍乱的病原体“霍乱弧菌”,它能够存活于水中,从而用科学证明了约翰·斯诺的假设。

斯诺通过比较两个人群组在统计意义上的不同,找出区分它们的关键因素,从而找到致病的原因,这个方法在统计学里叫做“假设检验”。斯诺以此为基础创建了一门非常伟大的学科叫流行病学(Epidemiology),他也被称为“流行病学之父”。为了纪念他,宽街的那口水井的水泵一直保留到现在,水井对面的酒吧被命名为“约翰·斯诺”。

研究流行病,就要找到病原、病的生成期、潜伏期、传染性、严重性、确诊性、病毒传播的模式、风险分析、干预政策的设计和评估、疫情分析和预测。流行病学中的数据科学不一定很复杂。就目前暴发的新冠肺炎疫情,伦敦帝国理工学院的科学家做了一系列研究。

2020年1月18日,伦敦帝国理工学院发表了第一份对武汉的疫情分析,预测患者接近4000人,而当时武汉确诊的病例是41例。 科学家通过离开武汉到了国外确诊的病例有7个,同时从国际航空报告里知道武汉每天有3300人出国。

科学家把每天出国的3300人作为一个在武汉抽样的样本,患病周期是10天,所以总体样本空间有33000人,其中7人是确诊病例,这样就可以算出感染的概率(7/3300*10)。

根据这个概率,可以计算出武汉的感染人数,虽然这是非常粗略的估计,但它却有统计学上的意义。

用动态数据模型来指导疫情防控

疫情每天都在变,健康的人变成感染的人,患者治愈了或不幸去世了,每天都有在动态变化。

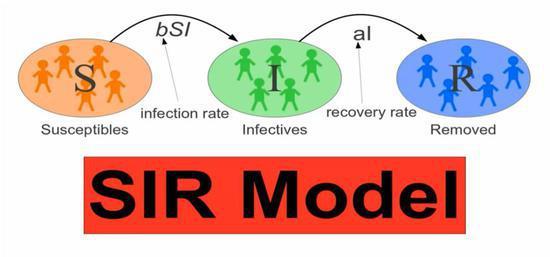

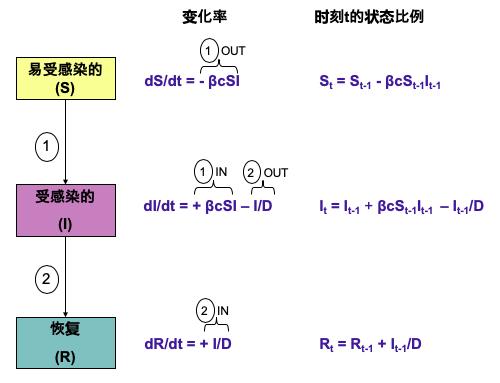

要掌握疫情的发展,特别是要了解干预政策怎样影响疫情的动态变化,就要建立流行病的动态模型(SIR模型),这又是数据科学非常重要的问题。

上个世纪二十年代,两位既是传染病学家也是物理学家的英国科学家科马克(W.O.Kermack)和马肯德莱克(A.G.Makenclrick),他们是把人群分为还未被感染的(易感人群,Susceptibles)、感染了的(传染人群,Infectives)、不再被/会感染的(免疫/死亡人群,封闭了的)群体,这三个群体之间的动态关系。就可称为SIR模型。

现在很多预测模型,千变万化,但共同点就是在刻画三个人群之间的动态变化的规律。研究这个规律,我们要看:

(1)从易感者(S)到感染者(I),这个叫感染的传播过程。我们要研究让易感者避免被感染,控制易感人群变成传染人群的速度,这便和干预措施有很大关系。

(2)从感染者(I)到不传染(R), 或叫被移除。不传染有各种情况:一部分是治好了,一般来说病毒性的疾病治好了就有免疫力,不会再被传染;一部分不幸死亡了,也不能再传染;还有一部分我们能够有很好的办法隔离起来,比如方舱医院,让感染者不再传染别人,也可以算是被移除的。

另外,还要看三个动态变化人群之间的关系:

①在给定时间(t)里,易感人群还有多少;

②被传染人群有多少(即已被感染并会传染的人数,我们每天报的疫情有确认的受感者,但报的是发现就诊的, 通常这只是真正受感染的很少的一部分);

③已经治愈的和死亡的数据有多少。这个数目比较确定。

如何创建动态系统数学模型?首先假设模型里每个人是在不断游走的,没有什么限制,接触概率是相同的。我们来研究在这样的环境里,传染病是怎么传播的。

然后开始有干预政策,不让人群那么自由的流动,减少人与人的接触,这样的模型就要做些改变。在动态模型里,我们要找到感染速度、恢复速度等一系列特征量。

感染速度:S→I rate = b*StIt

感染速度(S→I rate),是描述易感者被感染的转换过程的特征。

这个感染速度与两个因素成正比:①被感染人群的大小;②易感人群大小。

所以,感染速度等于易感人群(St)与感染人群(It)的乘积,还要再乘上感染速率参数(b)。

感染速率参数与两个因素有关:与传染接触的概率有关。人群接触少的,参数就会小一点。艾滋病是靠性传染,传染接触的概率一般不大, 而新冠病毒是靠飞沫传染,传染接触的概率就大,要控制人与人的接触就难一些;与疾病传染性有关,也就是说,一旦接触后被感染的概率有多大,或者说病毒的传染性有多强。

恢复速度:I→R rate = a*It

恢复速度(I→R rate),就是从感染者到不再感染者的过程有多长,也是我们常说的传染期。

恢复速度取决于感染人群的数量(It),和它的大小成正比。a是恢复速率参数,即如何让感染者不再传染。恢复速率参数与采取的措施有关,比如发现感染者及早完全隔离,切断传染,也和医治有关系,如找到有效的治疗方案。

有了相应的特征值后,我们就可以建立很好的流行病动态模型,研究三种人群之间动态的关系。实际上伦敦帝国理工学院的报告也是在这个基础上做的。

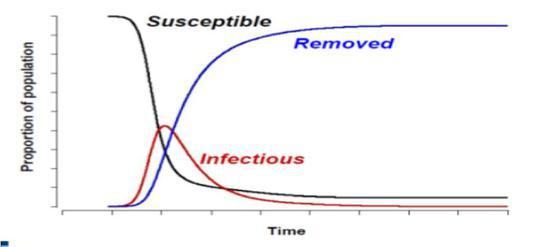

流行病动态模型基本是一条曲线:开始很多人是易感人群,慢慢这个人群减下来,因为都被感染了;感染人群慢慢上去了,到一定的地方出现拐点,因为没有那么多可以再感染的人群了;不被感染有很多因素,比如把人迁出去了,治愈的人变多了,建立方舱医院隔离了感染者;还有一种是什么都不做,这样拐点会被拖到很晚,很多人被感染,不过拐点总会出现的。

流行病动态模型曲线的变化要看采取的防治措施、整个的医疗水平和干预的方法。

我们现在经常会听到R0,即基本繁殖率,指每一个感染个体引发的平均新发感染人数。

R0>1,一个人传多人,感染传播开始流行;

R0=1, 一个人传一个人,感染保持恒定;

R0<1, 一个人传少于一个人,感染开始消失。

计算R0需要有三个参数:R0 =βcD传播概率(β):每次感染者与易感者之间每一次接触并不等于一定会受到感染,这个参数决定病毒的强度。

接触率(c):人与人接触的概率,有些病比如艾滋病通过性接触传染,接触率不会很大。像SARS、新冠肺炎等通过空气传染,对接触的管理就很难了。我们要避免人与人之间的接触,要戴口罩等等,都是降低接触率的办法。

感染持续时间(D):就是感染的治愈程度。除了治愈,不让感染者继续传染也是缩短感染持续时间的办法。

当然还有减少易感人群(S),就是疫苗的作用,也能降低有效繁殖率(Rt)。Rt = St*R0

综上,我们就可以建立一个完整的传染病模型:

模型看起来很复杂,实际上是非常简单的物理模型。有了这个模型,就可以把病毒离散化变成状态方程,就可以解出来。

实际上,这个模型还是比较粗糙的,很多因素并没有考虑在内:比如控制交通之后参数的改变,比如方舱医院建立以后对感染持续时间(D)的改变。这些因素放进去之后,方程会变复杂,但基本思想是一样的。

建立了一个刻画疾病传染的动态方程后,利用数据科学把这个方程与疾病的观察数据做拟合。

SIR模型最大的难点是数据很难获得。哪怕是新冠肺炎这么重大的疾病流行时,要想把有关疾病的数据拿给科学家做分析也是很麻烦,另外这些数据分析都是“事后诸葛亮”。数据分析应该是来指导政策的实施,而不仅仅是用来解释政策。当然,解释政策也很重要,要对政策实施进行评估。

那么能不能在传染病暴发之前,通过获得一些数据,把传染病的传染模型真正的研究出来呢?

大数据模拟, 让数据分析不再“事后诸葛亮”

2018年,西班牙大流感暴发100周年,BBC决定拍摄一部纪录片来讲讲流行病如何防治。问题是流感发生在100年前,当时的场景无法还原恢复。此时,剑桥大学女教授朱莉·果戈(Julia Gog)设计一个APP来模拟大流感。

APP可以收集每个人的位置信息、也可以报告用户之间的交互,有了这些数据就开始模拟流感。假定一个R0值,就可以看这个流感如何感染一个人;用什么办法控制一个区域,看R0值会有什么变化,或者传染率、传染速度也都可以模拟。

BBC Pandemic,大流感模拟实验APP

这个APP叫BBC Pandemic,有80,000多人下载。BBC Pandemic采的数据是公开的,同时BBC有很好的保护数据私密性的办法和措施。用户可以匿名报告自己的信息,比如性别、年龄、健康状况、职业(这很重要,关系到不同人的交往方式)。在用户许可的前提下,机器会不断上报用户的位置信息。数据传到后台云上后,系统会根据传染率通知用户在接触过程中是否被感染。

通过所有收集的数据最终可以做到,虽然没有在现实中发生传染病,但是已经可以通过模拟,知道传染病的传染方式和发展情况。

模拟完之后就可以来做对策,比如接种疫苗、做隔离等等的,这些措施的效果如何,全部可以被模拟出来。

整个APP的操作非常简单,而且参与者都很喜欢,像一个和感染作战的游戏。最终,BBC实现了对1918年西班牙大流感的模拟,并且收集了很多的数据,出了很多的研究文章,研究对这样的传染病暴发的各种各样干预方案的效果。该实验的结果发表在2018年《Epidemics》杂志上。

现在国内也有类似的系统,如阿里巴巴大数据疫情监控云屏、中国移动疫情专项分析服务、科大讯飞地方政府大数据疫情防控解决方案、个体移动轨迹追踪等等。

但是,这些分析服务都是在疫情暴发以后,实际上根本不需要等待疫情暴发,我们就完全可以建立这样的系统,这样,对于流行病,完全可以做到未卜先知。

由此,我们可以看到数据科学的重要作用:完全可以在一个疾病没有发生的时候,模拟疾病产生的可能,模拟各种防治方案的效果。这样,我们就可以做到科学精准的决策。不要等传染病来了再来求助于大数据,这样太晚了,付出的代价也太大。

智慧城市要有免疫力和抗灾力

基于大数据的疾病防控系统应该是我们建设智慧城市的一个根本出发点。大家都在做智慧城市,有智慧交通、智慧安防等等。但是一个城市真正想要有智慧,它就要有两个重要的方面:要清楚有很多信息可以采集;必须能够预见未来。

中国是大数据非常丰富的国家,运营商、互联网公司有大量的数据,能不能够用好它,真正把城市的免疫力、防灾性建立起来,这很重要。

疫情发生后,有了AI疫情应急大数据一体化智能测温预警解决方案,就能把数据都收集起来,但这个数据是“事后诸葛亮”。现在监控分析的是对有疫情城市的监控。有了疫情应急决策系统,比如疫情应急管理资源物资大数据、教育局疫情大数据决策系统。但这些系统的数据,没有在疫病之前,把预案做好,所以我们只能在今天的实践中试错,错了再改,付出的代价非常大。

所以,数据科学的可预见性非常重要。做大数据研究不是仅仅把生活中的数据拿来考虑怎么做好物流、怎么让不买东西的人去买东西,这些不是数据科学的全部内容。真正的数据科学是真真实实地知道现在,从而可以精确地预见未来,这是数据科学对社会、对人民最大的重要性。希望以后我们的城市能够变得真正有免疫的能力,疫病来了以后我们有抗灾的能力,能够保证人民生活的健康,保证他们的幸福生活。

推荐

《科学大家》专栏投稿邮箱:sciencetougao@sina.com 来稿请注明姓名、单位、职务