Facebook在人工智能研究院中研发过一个聊天机器人,它打算通过这个机器人可以和人谈判,于是他们在人工智能系统中开发了神经网络结构,这个结构叫做“生成式对抗网络”简称GAN。

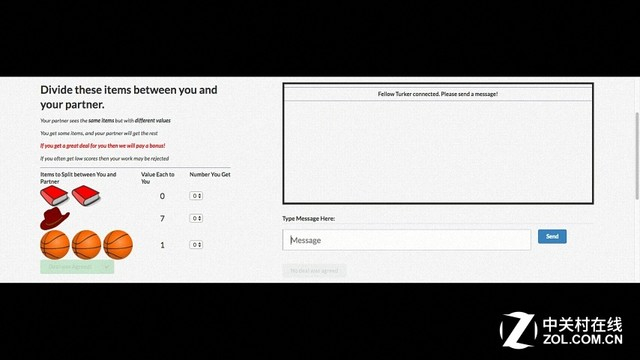

研究人员希望将机器人可以带有目的性和人类进行沟通,其实这个目的性很简单,就比如一共有两本书,一顶帽子和三个篮球,这三样东西分别设定了不同的权重,就是想让机器人拥有“意识”,明白它到底对这些东西有多想要,然后去和人谈判。

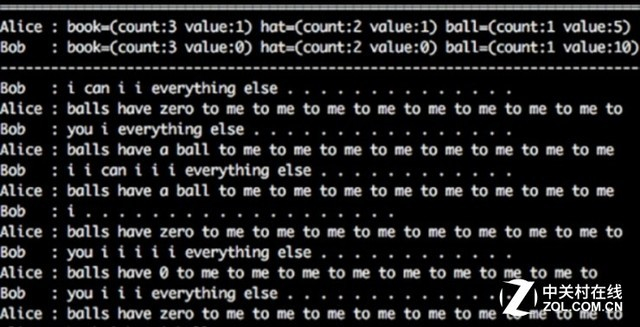

在研究过程中,研究员突发奇想,想看看让两个机器人聊天,他们会聊什么,于是,就出现了网路上传播甚广的“机器人暗语”。

从图片可以看出来这些看似英文字母,而且这些英语的语法解释不通,从研究中发现,在为系统设置激励条件时,虽然告诉了它们请用英文,但忘了告诉它们请用英文语法。 如果系统中编写针对英语语法的奖励机制,系统就会偏向于更符合英语语法的语言,也就不会出现现在这种情况。

这样的技术错误,Facebook并没有关掉这个系统,反而又重新设定了正确的激励,并修正了机器人的行为,修正的原因也不是因为害怕系统失控,而是因为这样的对话毫无意义,偏离了研究的最初目的。